La forma en que consumimos información en internet ha cambiado drásticamente. Ya no solo «buscamos» en una lista de enlaces; ahora «preguntamos» a modelos de inteligencia artificial como ChatGPT, Gemini, Claude o Perplexity. Para los desarrolladores y expertos en marketing, esto significa que el SEO tradicional está evolucionando hacia el GEO (Generative Engine Optimization).

En este nuevo ecosistema, ha surgido una herramienta minimalista pero revolucionaria: el archivo llms.txt. Si quieres que tu sitio web sea la fuente de verdad para las IAs, este archivo es tu mejor aliado.

¿Qué es exactamente el archivo llms.txt?

El archivo llms.txt es una propuesta de estándar técnico que consiste en un archivo de texto plano, formateado en Markdown, ubicado en el directorio raíz de un servidor web. Su función es similar a la del clásico robots.txt, pero con una diferencia fundamental: mientras que el robots.txt da instrucciones de exclusión (dónde no entrar), el llms.txt ofrece instrucciones de comprensión (qué leer y cómo entenderlo).

El objetivo es proporcionar a los Modelos de Lenguaje Extenso (LLMs) una versión destilada de tu sitio. En lugar de obligar a un bot a procesar pesados archivos HTML cargados de scripts de seguimiento, anuncios y elementos de diseño, le ofreces un resumen semántico que puede procesar de forma instantánea y económica.

¿Por qué es el nuevo estándar para el SEO moderno?

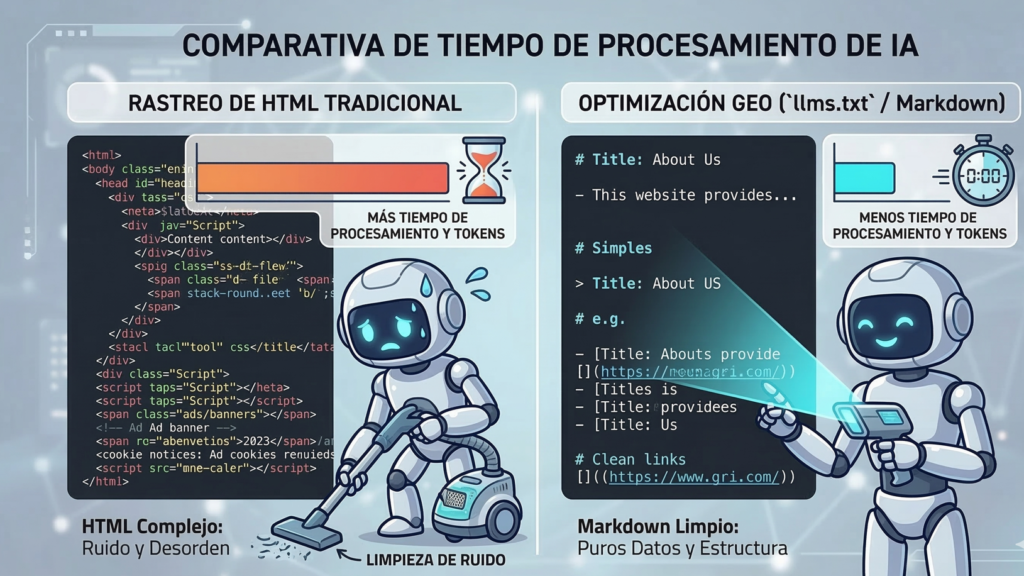

Para entender su importancia, debemos entender cómo «lee» la IA. Los modelos actuales tienen una «ventana de contexto», un límite de información que pueden procesar a la vez. Cuando un bot de IA rastrea una web convencional, gasta «tokens» (unidades de procesamiento) en limpiar el código basura antes de llegar al contenido real.

Al implementar un archivo llms.txt, eliminas esa fricción. Las ventajas son directas:

Precisión de marca: Evitas que la IA invente datos (alucinaciones) al darle información oficial y estructurada.

Velocidad de indexación: Los agentes de IA pueden mapear tu sitio mucho más rápido, lo que facilita que tus actualizaciones aparezcan en sus respuestas casi en tiempo real.

Autoridad semántica: Al usar Markdown, defines claramente las jerarquías de tu contenido, reforzando tu posición como experto en tu nicho.

Tutorial: Cómo añadir llms.txt a tu desarrollo web

Lo mejor de este estándar es que es agnóstico: funciona en WordPress, webs estáticas (Astro, Next.js), o desarrollos a medida en Python, PHP o Node.js.

Paso 1: Crear el archivo y definir la estructura

Crea un archivo llamado llms.txt con un editor de texto simple. La estructura debe ser clara y jerárquica. Aquí tienes un ejemplo base:

# Nombre de tu Proyecto o Empresa > Una breve descripción de una frase sobre lo que haces. ## Secciones Principales - [Blog de Tecnología](https://tuweb.com/blog): Guías sobre desarrollo y software. - [Servicios de Consultoría](https://tuweb.com/servicios): Detalles de nuestra oferta profesional. - [Documentación API](https://tuweb.com/docs): Especificaciones técnicas para desarrolladores. ## Información Crítica Incluye aquí datos que quieres que la IA priorice, como tu misión o datos de contacto.

Paso 2: Ubicación y accesibilidad

El archivo debe ser accesible públicamente en la ruta raíz: https://tusitio.com/llms.txt.

En proyectos modernos (Vite, Next.js): Súbelo a la carpeta

/public.En servidores tradicionales: Colócalo en el

public_htmlo la carpeta raíz de tu hosting.Importante: Asegúrate de que tu servidor sirva este archivo como

text/plain.

Paso 3: Implementar llms-full.txt (Opcional)

Para sitios con contenido muy extenso, se recomienda crear un archivo adicional llamado llms-full.txt. Este debe contener todo el contenido de tu web (artículos completos, documentación completa) en un solo archivo Markdown. Esto permite que una IA «absorba» todo tu conocimiento de una sola vez sin tener que hacer cientos de peticiones HTTP.

El impacto en el futuro del desarrollo web

Implementar llms.txt hoy es como haber implementado un sitemap.xml en los inicios de Google. Es una señal de que tu web está preparada para el futuro. A medida que más agentes autónomos de IA comiencen a ejecutar tareas por nosotros (como comprar productos o resumir investigaciones), estos archivos serán la puerta de entrada oficial a tu negocio.

Además, desde el punto de vista del rendimiento, reduces la carga de tu servidor. Los bots de IA son conocidos por ser agresivos en su rastreo; ofrecerles un archivo ligero de texto plano les permite obtener lo que buscan sin saturar tu ancho de banda.

Conclusión: No te quedes atrás en la carrera de la IA

El SEO ya no se trata solo de palabras clave y enlaces; se trata de disponibilidad de datos. El archivo llms.txt es la herramienta más sencilla y eficiente para asegurar que tu sitio web sea comprendido por la nueva generación de buscadores. En menos de 10 minutos, puedes pasar de ser un sitio web «invisible» para los modelos de lenguaje a convertirte en su fuente de referencia preferida.